时隔半年之后,Meta AI在本周二公开联动新一代的开源大模型Llama 2。

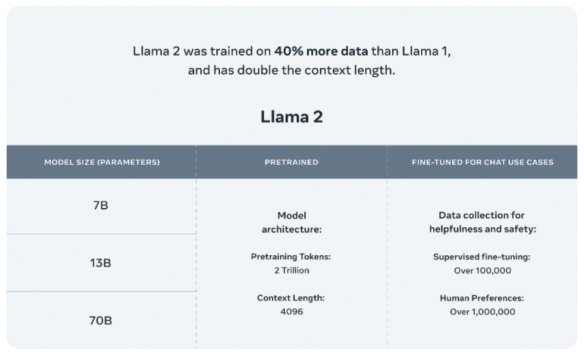

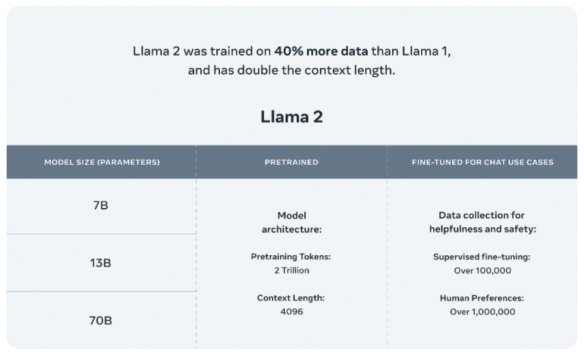

与2月发布的Llama 1相比,训练所用的token翻了一倍至2万亿,同时对于使用大模型最重要的上下文长度限制,Llama 2也翻了一倍。Llama 2包含了70亿、130亿和700亿参数的模型。

Meta同样在本周二宣布,他们将与微软云服务Azure合作,向全球开发者首发基于Llama 2模型的云服务。并且还将与高通合作,Llama 2将能够在高通芯片上运行,打破市场上英伟达、AMD处理器对AI产业的垄断。

时隔半年之后,Meta AI在本周二公开联动新一代的开源大模型Llama 2。

与2月发布的Llama 1相比,训练所用的token翻了一倍至2万亿,同时对于使用大模型最重要的上下文长度限制,Llama 2也翻了一倍。Llama 2包含了70亿、130亿和700亿参数的模型。

Meta同样在本周二宣布,他们将与微软云服务Azure合作,向全球开发者首发基于Llama 2模型的云服务。并且还将与高通合作,Llama 2将能够在高通芯片上运行,打破市场上英伟达、AMD处理器对AI产业的垄断。